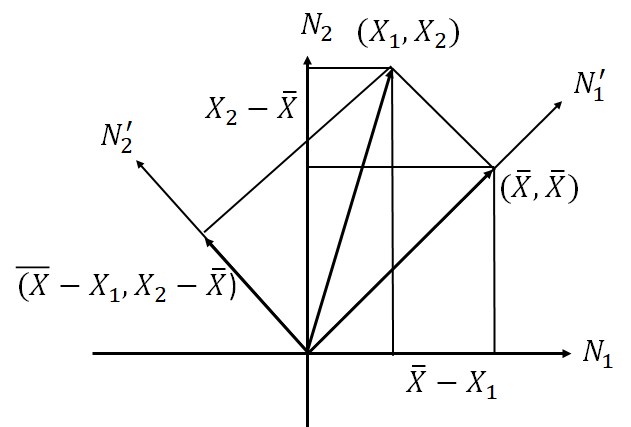

оценка дисперсии без учета числа степеней свободы называется

Понятие описательной статистики и ее показателей для выборок

Начальный раздел математической статистики – описательная статистика занимается характеристикой (описанием) случайного рассеяния по выборочной совокупности данных, оценивает закон распределения и обобщенные выборочные характеристики (параметры). Их смысл пояснялся при имитации совокупности случайных данных кучей песка, и ниже рассматривается более строго.

Они понимаются, как оценки положения центра распределения (его расположения на числовой оси случайной величины). Центр распределения характеризуется средним случайной величины; серединой упорядоченной совокупности и наиболее часто встречающейся величиной. Эти параметры положения имеют размерность самих случайных величин.

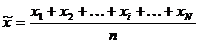

где n – объем выборки. Если варианты сгруппированы в n интервалов со средними значениями х1, х2, …, хi, …, хn, и числом вариант в каждом n1, n2, …,ni, …, nn, то среднее арифметическое рассчитывается как среднее взвешенное:

Среднее взвешенное всей генеральной совокупности, подсчитываемое с использованием вероятностей случайной величины в качестве весов, называется математическим ожиданием. Очевидно, среднее взвешенное в выборке является оценкой среднего взвешенного генеральной совокупности и оценкой математического ожидания генеральной совокупности.

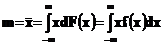

Среднее взвешенное является начальным моментом первого порядка, который имеет обозначение m. Для непрерывных случайных величин он, математическое ожидание (и среднее взвешенное) определяются интегралами:

Для дискретных случайных величин, вместо интегралов берутся соответствующие суммы. Можно показать, что выборочное среднее (оценка математического ожидания) имеет минимальную сумму квадратов отклонений от значений случайной величины в выборке. Среднему случайной величины при имитации распределениярассеяниемпескаотвечает центр тяжести кучи. Центр тяжести одномерной массы, распределенной с некоторой плотностью вдоль оси значений случайной величины, является начальным моментом первого порядка, т.е. средним взвешенным.

При симметричном распределении случайной величинысреднее арифметическое (математическое ожидание), как и центр тяжести одномерной массы, симметрично распределенной вдоль оси, совпадают с центром симметрии.

Из закона больших чисел следует, что с увеличением объема выборки ее среднее арифметическое стремится к среднему арифметическому генеральной совокупности (математическому ожиданию).

2. Медиана случайной величины – это такое ее значение, которое делит совокупность на две равные части: большие и меньшие медианы.

В куче песка,имитирующей совокупность случайных величин, медиана – линия в основании, вертикальная плоскость через которую делит кучу на две части с равным числом песчинок.

Площадь под графиком плотности вероятностей одномерного распределения случайной величины делится пополам по медианному значению. В симметричном распределении медиана и математическое ожидание совпадают.

3. Мода распределения случайной величины – такое ее значение, которое встречается наиболее часто. Мода распределения отвечает горизонтальной проекции вершины кучи песка,имитирующей совокупность случайных величин. Мода соответствует максимуму плотности вероятностей. В симметричном распределении мода, медиана и математическое ожидание совпадают.

К параметрам рассеяния относятся оценки степени разброса случайной величины. Эти параметры в аналогии рассеяния случайной величины с кучей песка характеризуют ее компактность, близость песчинок к центру.

1. Дисперсия выборки определяется как математическое ожидание квадрата отклонения случайной величины от своего математического ожидания, т.е. средний квадрат отклонений случайной величины от ее среднего.

Дисперсия, которую принято обозначать D является центральным моментом второго порядка, обозначаемым m2. Т.е. D=m2.

Дисперсия непрерывной случайной величины определяется интегралом:

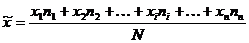

Для выборки случайных величин объемом N вариант оценка дисперсии подсчитывается по формуле

где s – число степеней свободы. Величина s определяется количеством вариант за вычетом числа наложенных связей, т.е.s показывает, сколько вариант в выборке может изменяться случайным образом при наложенном условии. Так сумма двух случайных чисел имеет 2 степени свободы, поскольку каждое из них может выбираться случайно. Но если наложить условие равенства среднего из чисел некоторому значению, то только одно число выбирается случайно, а второе определяется условием из соответствующего ему уравнения. Поэтому число степеней свободы определится как 2-1=1.

При определении дисперсии с априорно известным математическим ожиданием s=N. Но, если в качестве оценки математического ожидания берется его выборочная величина по данным той же выборки, то тем самым на нее накладывается одно условие – варианты должны удовлетворять уравнению:

Соответственно число степеней свободы составитs=N-1. Когда N достаточно велико, N»N-1, т.е. уменьшением числа степеней свободы можно пренебречь. Но в общем случае оценка дисперсии, без учета числа степеней свободы оказывается заниженной и называется смещенной. Оценка дисперсии, подсчитанная с учетом числа степеней свободы, является несмещенной.

3. Коэффициент вариации – это относительный показатель рассеяния, равный отношению стандартного отклонения к среднему значению случайной величины. Если обозначить коэффициент вариации V, то V=d/m= d/

4. Размах случайной величины – это разность между максимальным и минимальным значениями, приблизительно в 6 раз превышающая стандарт. В аналогии рассеяния случайной величины с кучей песка размаху отвечает ширина кучи в основании, т.е. границы области рассеяния.

Параметры формы распределения

Основными параметрами формы распределения случайной величины являются показатели асимметрии и островершинности.

В симметричных распределенияхm3=0 иА=0, т.е. асимметрия, естественно, отсутствует. При положительной асимметрии кривая плотности вероятностей затянута вправо (в сторону больших значений случайной величины), при отрицательной асимметрии – влево.

Нормальное распределение случайной величины является симметричным, А=0. Статистически значимое отклонение асимметрии от нуля указывает на несогласие тестируемого распределения с симметричным законом и, в частности, с нормальным.

О степенях свободы в статистике

В одном из предыдущих постов мы обсудили, пожалуй, центральное понятие в анализе данных и проверке гипотез — p-уровень значимости. Если мы не применяем байесовский подход, то именно значение p-value мы используем для принятия решения о том, достаточно ли у нас оснований отклонить нулевую гипотезу нашего исследования, т.е. гордо заявить миру, что у нас были получены статистически значимые различия.

Однако в большинстве статистических тестов, используемых для проверки гипотез, (например, t-тест, регрессионный анализ, дисперсионный анализ) рядом с p-value всегда соседствует такой показатель как число степеней свободы, он же degrees of freedom или просто сокращенно df, о нем мы сегодня и поговорим.

Степени свободы, о чем речь?

По моему мнению, понятие степеней свободы в статистике примечательно тем, что оно одновременно является и одним из самым важных в прикладной статистике (нам необходимо знать df для расчета p-value в озвученных тестах), но вместе с тем и одним из самых сложных для понимания определений для студентов-нематематиков, изучающих статистику.

Давайте рассмотрим пример небольшого статистического исследования, чтобы понять, зачем нам нужен показатель df, и в чем же с ним такая проблема. Допустим, мы решили проверить гипотезу о том, что средний рост жителей Санкт-Петербурга равняется 170 сантиметрам. Для этих целей мы набрали выборку из 16 человек и получили следующие результаты: средний рост по выборке оказался равен 173 при стандартном отклонении равном 4. Для проверки нашей гипотезы можно использовать одновыборочный t-критерий Стьюдента, позволяющий оценить, как сильно выборочное среднее отклонилось от предполагаемого среднего в генеральной совокупности в единицах стандартной ошибки:

Проведем необходимые расчеты и получим, что значение t-критерия равняется 3, отлично, осталось рассчитать p-value и задача решена. Однако, ознакомившись с особенностями t-распределения мы выясним, что его форма различается в зависимости от числа степеней свобод, рассчитываемых по формуле n-1, где n — это число наблюдений в выборке:

Сама по себе формула для расчета df выглядит весьма дружелюбной, подставили число наблюдений, вычли единичку и ответ готов: осталось рассчитать значение p-value, которое в нашем случае равняется 0.004.

Но почему n минус один?

Когда я впервые в жизни на лекции по статистике столкнулся с этой процедурой, у меня как и у многих студентов возник законный вопрос: а почему мы вычитаем единицу? Почему мы не вычитаем двойку, например? И почему мы вообще должны что-то вычитать из числа наблюдений в нашей выборке?

В учебнике я прочитал следующее объяснение, которое еще не раз в дальнейшем встречал в качестве ответа на данный вопрос:

“Допустим мы знаем, чему равняется выборочное среднее, тогда нам необходимо знать только n-1 элементов выборки, чтобы безошибочно определить чему равняется оставшейся n элемент”. Звучит разумно, однако такое объяснение скорее описывает некоторый математический прием, чем объясняет зачем нам понадобилось его применять при расчете t-критерия. Следующее распространенное объяснение звучит следующим образом: число степеней свободы — это разность числа наблюдений и числа оцененных параметров. При использовании одновыборочного t-критерия мы оценили один параметр — среднее значение в генеральной совокупности, используя n элементов выборки, значит df = n-1.

Однако ни первое, ни второе объяснение так и не помогает понять, зачем же именно нам потребовалось вычитать число оцененных параметров из числа наблюдений?

Причем тут распределение Хи-квадрат Пирсона?

Давайте двинемся чуть дальше в поисках ответа. Сначала обратимся к определению t-распределения, очевидно, что все ответы скрыты именно в нем. Итак случайная величина:

имеет t-распределение с df = ν, при условии, что Z – случайная величина со стандартным нормальным распределением N(0; 1), V – случайная величина с распределением Хи-квадрат, с ν числом степеней свобод, случайные величины Z и V независимы. Это уже серьезный шаг вперед, оказывается, за число степеней свободы ответственна случайная величина с распределением Хи-квадрат в знаменателе нашей формулы.

Давайте тогда изучим определение распределения Хи-квадрат. Распределение Хи-квадрат с k степенями свободы — это распределение суммы квадратов k независимых стандартных нормальных случайных величин.

Кажется, мы уже совсем у цели, по крайней мере, теперь мы точно знаем, что такое число степеней свободы у распределения Хи-квадрат — это просто число независимых случайных величин с нормальным стандартным распределением, которые мы суммируем. Но все еще остается неясным, на каком этапе и зачем нам потребовалось вычитать единицу из этого значения?

Давайте рассмотрим небольшой пример, который наглядно иллюстрирует данную необходимость. Допустим, мы очень любим принимать важные жизненные решения, основываясь на результате подбрасывания монетки. Однако, последнее время, мы заподозрили нашу монетку в том, что у нее слишком часто выпадает орел. Чтобы попытаться отклонить гипотезу о том, что наша монетка на самом деле является честной, мы зафиксировали результаты 100 бросков и получили следующий результат: 60 раз выпал орел и только 40 раз выпала решка. Достаточно ли у нас оснований отклонить гипотезу о том, что монетка честная? В этом нам и поможет распределение Хи-квадрат Пирсона. Ведь если бы монетка была по настоящему честной, то ожидаемые, теоретические частоты выпадания орла и решки были бы одинаковыми, то есть 50 и 50. Легко рассчитать насколько сильно наблюдаемые частоты отклоняются от ожидаемых. Для этого рассчитаем расстояние Хи-квадрат Пирсона по, я думаю, знакомой большинству читателей формуле:

Где O — наблюдаемые, E — ожидаемые частоты.

Дело в том, что если верна нулевая гипотеза, то при многократном повторении нашего эксперимента распределение разности наблюдаемых и ожидаемых частот, деленная на корень из наблюдаемой частоты, может быть описано при помощи нормального стандартного распределения, а сумма квадратов k таких случайных нормальных величин это и будет по определению случайная величина, имеющая распределение Хи-квадрат.

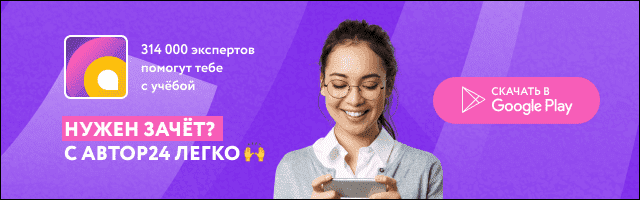

Давайте проиллюстрируем этот тезис графически, допустим у нас есть две случайные, независимые величины, имеющих стандартное нормальное распределение. Тогда их совместное распределение будет выглядеть следующим образом:

При этом квадрат расстояния от нуля до каждой точки это и будет случайная величина, имеющая распределение Хи-квадрат с двумя степенями свободы. Вспомнив теорему Пифагора, легко убедиться, что данное расстояние и есть сумма квадратов значений обеих величин.

Пришло время вычесть единичку!

Ну а теперь кульминация нашего повествования. Возвращаемся к нашей формуле расчета расстояния Хи-квадрат для проверки честности монетки, подставим имеющиеся данные в формулу и получим, что расстояние Хи-квадрат Пирсона равняется 4. Однако для определения p-value нам необходимо знать число степеней свободы, ведь форма распределения Хи-квадрат зависит от этого параметра, соответственно и критическое значение также будет различаться в зависимости от этого параметра.

Теперь самое интересное. Предположим, что мы решили многократно повторять 100 бросков, и каждый раз мы записывали наблюдаемые частоты орлов и решек, рассчитывали требуемые показатели (разность наблюдаемых и ожидаемых частот, деленная на корень из ожидаемой частоты) и как и в предыдущем примере наносили их на график.

Легко заметить, что теперь все точки выстраиваются в одну линию. Все дело в том, что в случае с монеткой наши слагаемые не являются независимыми, зная общее число бросков и число решек, мы всегда можем точно определить выпавшее число орлов и наоборот, поэтому мы не можем сказать, что два наших слагаемых — это две независимые случайные величины. Также вы можете убедиться, что все точки действительно всегда будут лежать на одной прямой: если у нас выпало 30 орлов, значит решек было 70, если орлов 70, то решек 30 и т.д. Таким образом, несмотря на то, что в нашей формуле было два слагаемых, для расчета p-value мы будем использовать распределение Хи-квадрат с одной степенью свободы! Вот мы наконец-то добрались до момента, когда нам потребовалось вычесть единицу. Если бы мы проверяли гипотезу о том, что наша игральная кость с шестью гранями является честной, то мы бы использовали распределение Хи-квадрат с 5 степенями свободы. Ведь зная общее число бросков и наблюдаемые частоты выпадения любых пяти граней, мы всегда можем точно определить, чему равняется число выпадений шестой грани.

Все становится на свои места

Теперь, вооружившись этими знаниями, вернемся к t-тесту:

в знаменателе у нас находится стандартная ошибка, которая представляет собой выборочное стандартное отклонение, делённое на корень из объёма выборки. В расчет стандартного отклонения входит сумма квадратов отклонений наблюдаемых значений от их среднего значения — то есть сумма нескольких случайных положительных величин. А мы уже знаем, что сумма квадратов n случайных величин может быть описана при помощи распределения хи-квадрат. Однако, несмотря на то, что у нас n слагаемых, у данного распределения будет n-1 степень свободы, так как зная выборочное среднее и n-1 элементов выборки, мы всегда можем точно задать последний элемент (отсюда и берется это объяснение про среднее и n-1 элементов необходимых для однозначного определения n элемента)! Получается, в знаменателе t-статистики у нас спрятано распределение хи-квадрат c n-1 степенями свободы, которое используется для описания распределения выборочного стандартного отклонения! Таким образом, степени свободы в t-распределении на самом деле берутся из распределения хи-квадрат, которое спрятано в формуле t-статистики. Кстати, важно отметить, что все приведенные выше рассуждения справедливы, если исследуемый признак имеет нормальное распределение в генеральной совокупности (или размер выборки достаточно велик), и если бы у нас действительно стояла цель проверить гипотезу о среднем значении роста в популяции, возможно, было бы разумнее использовать непараметрический критерий.

Схожая логика расчета числа степеней свободы сохраняется и при работе с другими тестами, например, в регрессионном или дисперсионном анализе, все дело в случайных величинах с распределением Хи-квадрат, которые присутствуют в формулах для расчета соответствующих критериев.

Таким образом, чтобы правильно интерпретировать результаты статистических исследований и разбираться, откуда возникают все показатели, которые мы получаем при использовании даже такого простого критерия как одновыборочный t-тест, любому исследователю необходимо хорошо понимать, какие математические идеи лежат в основании статистических методов.

Онлайн курсы по статистике: объясняем сложные темы простым языком

Стоит также отметить, что теоретические знания в области статистики будут определенно полезны не только тем, кто применяет статистику в академических целях, но и для тех, кто использует анализ данных в прикладных областях. Базовые знания в области статистики просто необходимы для освоения более сложных методов и подходов, которые используются в области машинного обучения и Data Mining. Таким образом, успешное прохождение наших курсов по введению в статистику — хороший старт в области анализа данных. Ну а если вы всерьез задумались о приобретении навыков работы с данными, думаем, вас может заинтересовать наша онлайн — программа по анализу данных, о которой мы подробнее писали здесь. Упомянутые курсы по статистике являются частью этой программы и позволят вам плавно погрузиться в мир статистики и машинного обучения. Однако пройти эти курсы без дедлайнов могут все желающие и вне контекста программы по анализу данных.

Приложение 3. Степени свободы

В тех главах нашего учебника, где рассматривались различные оценки, вычисляемые с помощью сумм квадратов, возникал вопрос о числе степеней свободы для этих сумм. Первый раз такой вопрос возник, когда в выборочной оценке дисперсии сумма квадратов отклонений делилась не на n (количество слагаемых под знаком корня), а на \( n-1 \) . Затем более серьезные вопросы возникали, когда объявлялось, что в одновыборочной t-статистике в знаменателе формулы под корнем стоят n слагаемых, представляющих собой квадраты отклонений, но эта сумма имеет \( n-1 \) степеней свободы. За всеми этими и другими аналогичными случаями, которые встретились нам в курсе статистических методов, стоит одна и та же суть дела, которую мы сейчас и рассмотрим.

Мы разберем простейший пример такого снижения числа степеней свободы и разъясним, как он должен обобщаться. Доказательство основного утверждения будет проведено для случая плоскости, требующего фактически только хорошего уровня школьных знаний, но обобщение доказательства требует понимания «устройства» n-мерного пространства, т.е. подразумевает знакомство с основами линейной алгебры.

Тогда случайная величина \( S^2 \) имеет распределение Хи-квадрат с числом степеней свободы, равным \( n-1 \) .

Прежде чем доказывать теорему, надо разъяснить, что представляет собой случайная величина, имеющая распределение Хи-квадрат с k степенями свободы. Напомним, что такое распределение имеет случайная величина

где \( N_i \) — независимые испытания стандартной нормальной случайной величины.

Мы рассмотрим сначала распределение Хи-квадрат с двумя степенями свободы, которое оказывается очень похоже на распределение квадрата длины расстояния от центра мишени до пулевого отверстия (см. 3.1.5).

Для понимания дальнейшего материала требуется составить понятие о двумерной стандартной нормальной величине, которая и описывает распределение пулевых отверстий нашего примера.

П3.1. Двумерное стандартное нормальное распределение

Двумерное стандартное нормальное распределение можно задать как распределение положения на плоскости случайной точки, каждая из координат которой независимо описывается стандартным нормальным распределением. Плотность распределения положения точки будет функцией, заданной на плоскости. Вероятность того, что результат испытания двумерной величины попадет в определенную область, вычисляется как интеграл этой функции по данной области. Чтобы понять суть дела, вспомним, что для обычного стандартного нормального распределения вероятность попадания в очень маленький отрезок длины \( l_x \) с левым концом в точке a оси X может быть приблизительно рассчитан как произведение длины отрезка на значение плотности распределения в точке a. Это произведение равно

т.е. равно площади прямоугольника (она равна \( l_x\cdot l_y \) ), умноженной на произведение покоординатных плотностей, равное

Если превратить произведение экспонент в экспоненту суммы, то произведение плотностей равно

и задает плотность двумерного стандартного нормального распределения.

П3.2. Свойства двумерного стандартного распределения

Свойство П3.2(1). Проекция случайной точки, положение которой задается двумерной стандартной случайной величиной, на любую прямую, проходящую через начало координат, имеет стандартное нормальное распределение.

Нам потребуется частный случай этого свойства, когда прямая наклонена под углом 45 градусов к осям.

Сделаем двумерную замену переменных, определяемую уравнениями

Новые координатные оси являются биссектрисами старых координатных углов. Старые координаты выражаются тогда через новые по формулам

Подставим эти выражения в формулу плотности распределения и получим для новых координат

возведя в квадрат дроби и приведя подобные члены:

Это значит, что плотность двумерного нормального распределения в новых осях выглядит точно так же, как и в старых:

В этом нет ничего удивительного — поскольку \( x^2+y^2=C \) есть уравнение окружности, то наша плотность \( p(x,y) \) имеет одинаковые значения на всякой окружности с центром в начале координат, т.е. обладает центральной симметрией, поэтому и выглядит одинаково при любых поворотах системы координат.

Свойство П3.1(1), стало быть, выражает тот факт, что, задав двумерное нормальное распределение какими-то осями, мы затем можем смотреть на это распределение, так сказать, наклонив голову (для нашего преобразования координат достаточно наклонить голову влево на 45 градусов, чтобы новые оси выглядели точно как старые при вертикальном положении головы) и получая новые стандартно нормально распределенные проекции на новые оси.

П3.3. Свойства случайной величины, являющейся квадратом модуля двумерной стандартной нормальной случайной величины

По теореме Пифагора

Но точно так же \( N^2_

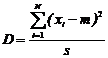

Посмотрим теперь, что представляет собой \( N^2_

Рис. П3.3(1). Разложение сумм квадратов

П3.4. Оценка дисперсии

Предположим сначала, что математическое ожидание нормально распределенной случайной величины нам известно, а дисперсия неизвестна. Пусть дана случайная величина X с математическим ожиданием \( M_X \) . Мы хотим оценить ее дисперсию по выборке. Тогда нам подойдет естественная оценка дисперсии со знаменателем n:

Для дискретной случайной величины доказательство того, что это — оценка дисперсии можно провести совершенно аналогично доказательству того, что среднее выборочное есть оценка математического ожидания — надо увидеть, что частоты каждого значения (в данном случае квадрата отклонения) сходятся к соответствующим вероятностям. Для непрерывной случайной величины доказательство технически усложняется, но по смыслу остается тем же.

Сумма \( X_1^2+X_2^2 \) разлагается в сумму \( \overline

П3.5. Разложение сумм квадратов в случае больших размерностей

Если теперь рассмотреть выборку объема n испытаний стандартной нормальной случайной величины, то надо разложить квадрат вектора, имеющего стандартное нормальное n-мерное распределение, в сумму квадрата одномерного распределения вдоль вектора (1,1,…,1) (это будет вектор \( (\overline

П3.6. Оценка дисперсии. Последнее замечание

Если теперь мы захотим оценить неизвестную дисперсию нормально распределенной случайной величины с неизвестным математическим ожиданием, то мы должны воспользоваться формулой

Если эта дисперсия равна какому-то числу D, то этому же числу будет равно в среднем наше \( s^2 \) , имеющее в этом случае распределение, пропорциональное Хи-квадрат с коэффициентом пропорциональности D.

П3.7. Другие разложения сумм квадратов

Каждое отдельное приложение представленного подхода требует особых разложений сумм квадратов и особых доказательств.

Во всех случаях подобных разложений сначала выделяют взаимно ортогональные подпространства в пространстве, размерность которого равна общему числу испытуемых, а затем производят разложение квадрата стандартного нормально распределенного многомерного вектора по этим направлениям (хотя доказательство ортогональности иногда представляет значительную трудность).

[1] Это сумма одномерных подпространств, заданных средними по каждой группе с условием после выделения общего среднего, что сумма этих средних равна нулю — что и делает размерность подпространства равной \( k-1 \) .

Если вы нашли ошибку, пожалуйста, выделите фрагмент текста и нажмите Ctrl+Enter.