Система neural engine что это

О технологии Neural Engine в процессорах Apple A-серии

Было опубликовано 20 января 2020 года

Обновлено 2 декабря 2020 года

Приставка «Bionic» к названию процессоров появилось не просто так. На кристалле стал размещаться еще один процессор, который маркетинг Apple назвала «нейронным движком» (Neural Engine).

Он основан на нейронных сетях, которым еще лет 20 назад пророчили лидирующую роль в вычислительной технике.

Позже на помощь Neural Engine пришли блоки AMX, но об этом ниже.

Для чего нужен Neural Engine

Отдельный процессор NPU значительно ускоряет работу таких ресурсоёмких задач как: дополненная реальность (поддерживаемая фреймворком Apple ARKit), машинное обучение и построение нейронных сетей (поддерживаемые фреймворком Apple Core ML).

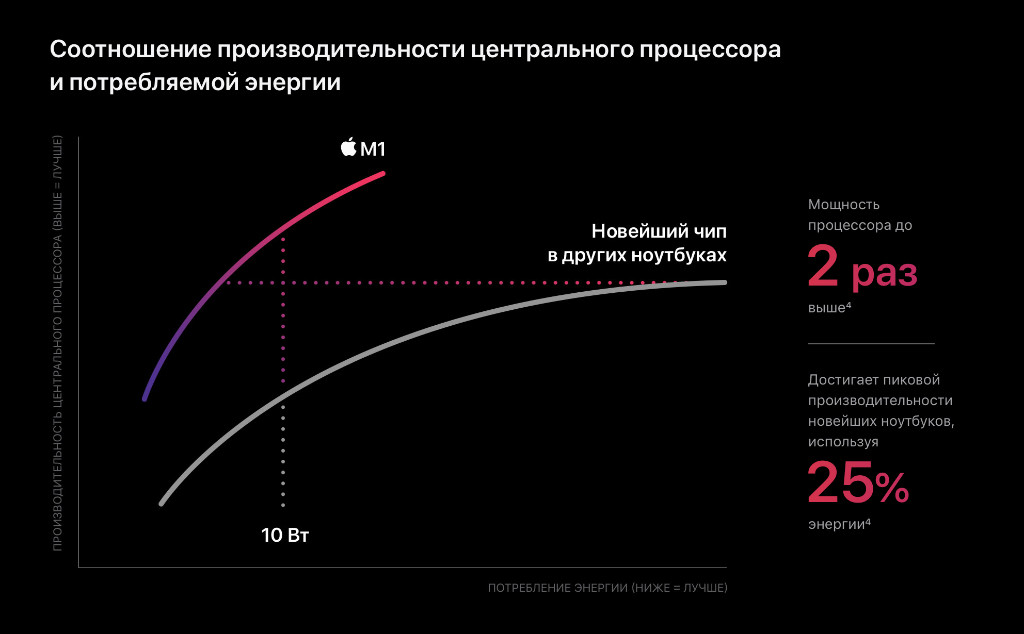

Технология позволяет Apple реализовать нейронную сеть и машинное обучение более энергоэффективным способом, чем использование основного или графического процессора. CPU и GPU не предназначены для работы с ИИ.

Первое поколение

Впервые нейронный процессор появился в Apple A11 Bionic. Предыдущий чип Apple A10 имел приставку Fusion.

Это первое поколение Neural Engine, которое было встроено чип Apple. В него установлено 2 ядра и оно может выполнять до 600 миллиардов операций в секунду.

Сторонние приложения не могут использовать нейронный движок этого поколения, что приводит к аналогичной производительности нейронной сети для старых iPhone.

Второе поколение

Следующее поколение сделало достаточно большой рывок по сравнению с предыдущим.

Вторая версия включает в себя “нейронный движок» следующего поколения, который установлен сразу в трех чипах компании Apple. Это поколение имеет целых 8 ядер и может выполнять до 5 триллионов операций в секунду, что до 9 раз быстрее по сравнению с Apple A11.

В отличие от Neural Engine 1-го поколения, 2-ое поколение предоставляет доступ для сторонних приложений.

Третье поколение

Третье поколение не сильно продвинулось по сравнению со вторым, но улучшения есть.

Следующий процессор Apple A-серии также включает в себя Neural Engine нового поколения. Имеет 8 ядер, как и ранее, которые стали на 20% быстрее и на 15% меньше потребляют энергию, а также работают до 6 раз производительнее.

Apple добавила в 3 – е поколении специальный ускоритель — блоки AMX. Они ориентированы на выполнение ключевых задач машинного обучения.

Четвертое поколение

Это поколение стало первым для Mac. Neural Engine этого поколения стал сильно лучше в задачах с использованием ИИ.

Четвертая версия содержит в себе нейронный процессор более нового поколения. В нем установлено 16 ядер, больше чем ранее в целых два раза. Они выполняют до 11 триллионов операций за 1 секунду, что по утверждениям Apple на 80% быстрее.

В чипах использующих это поколение, как и в A13, установлен специальный ускоритель — блоки AMX. Они ориентированы на выполнение ключевых задач машинного обучения.

Реализуем машинное обучение на iOS-устройстве с использованием Core ML, Swift и Neural Engine

Привет, хабр! В преддверии старта продвинутого курса «Разработчик iOS», мы традиционно подготовили для вас перевод полезного материала.

Введение

Core ML — это библиотека машинного обучения, выпущенная в свет Apple на WWDC 2017.

Она позволяет iOS разработчикам добавлять в свои приложения персонализированный опыт в режиме реального времени с использованием передовых локальных моделей машинного обучения с помощью Neural Engine.

Обзор чипа A11 Bionic

Количество транзисторов: 4.3 миллиарда

Количество ядер: 6 ядер ARM (64 бита) – 2 высокочастотных (2.4 ГГц) — 4 с низким энергопотреблением

Количество графических процессоров: 3

Neural Engine – 600 базовых операций в секунду

12 сентября 2017 Apple представила миру чип A11 Bionic с Neural Engine. Это нейросетевое аппаратное обеспечение может выполнять до 600 базовых операций в секунду (BOPS) и используется для FaceID, Animoji и других задач машинного обучения. Разработчики могут использовать Neural Engine с помощью Core ML API.

Core ML оптимизирует производительность на устройстве за счет использования ресурсов центрального процессора, графического процессора и Neural Engine, минимизируя объем памяти и энергопотребление.

Запуск модели локально на устройстве пользователя устраняет необходимость в сетевом подключении, что помогает сохранять конфиденциальность данных пользователя и улучшает отклик вашего приложения.

Core ML является основой для фреймворков и функционала данной предметной области. Core ML поддерживает Vision для анализа изображений, Natural Language для обработки текста, Speech для преобразования звука в текст и Sound Analysis для идентификации звуков в аудио.

Core ML API

Мы можем легко автоматизировать задачу построения моделей машинного обучения, что включают в себя обучение и тестирование модели, используя Playground, и интегрировать полученный файл модели в наш iOS проект.

Совет для новичков: Выделяйте отдельные метки для задач классификации.

Общая блок-схема Core ML

Ладно. Что мы будем создавать?

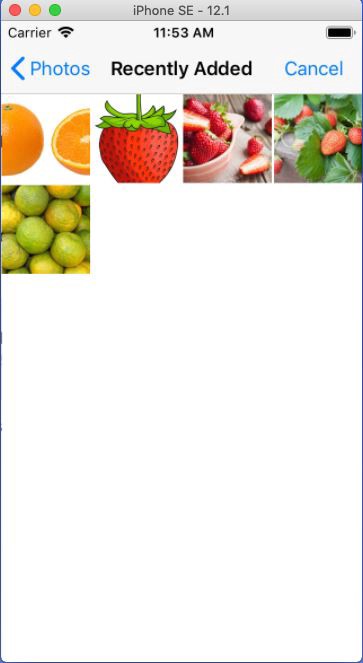

В этом уроке я покажу вам, как построить модель классификатора изображений с использованием Core ML, который может классифицировать изображения апельсинов (Orange) и клубники (Strawberry), и добавить эту модель в наше iOS приложение.

Модель классификатора изображений.

Подсказка для новичков: Классификация изображений относится к задачам обучения с учителем, в которых мы используем помеченные данные (в нашем случае метка (label) — название изображения).

Необходимый минимум:

Сбор данных

При сборе данных для классификации изображений следуйте следующим рекомендациям Apple.

После того как вы собрали ваш набор данных (Data Set), разделите его на обучающий (Train) и проверочный (Test) наборы и поместите их в соответствующие папки

ВАЖНОЕ ПРИМЕЧАНИЕ : Убедитесь что вы распределили изображения по соответствующим папкам внутри папки test. Потому что имя папки служит меткой для наших изображений.

В нашем случае у нас есть две папки, в каждой из которых лежат соответствующие изображения.

Создание модели

Не паникуйте! Apple значительно упростила эту задачу, автоматизировав основные этапы.

С Core ML вы можете использовать уже обученную модель для классификации входных данных или создать свою собственную. Для применения моделей классификации к изображениям и предварительной обработки этих изображений, и чтобы сделать задачи машинного обучения более простыми и надежными, с Core ML уже работает фреймворк Vision.

Просто следуйте этим шагам.

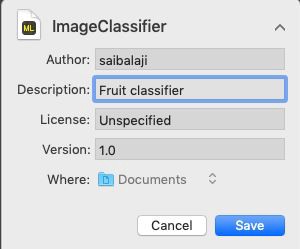

Описание:

Здесь мы открываем интерфейс билдера модели по умолчанию предоставленного XCode.

ШАГ 4: Перетащите папку с обучающей выборкой в область обучения.

Поместите папку с обучающей выборкой в область обучения, обозначенную пунктирными линиями.

Совет для новичков : Мы также можем указать произвольное имя для нашей модели, щелкнув стрелку вниз в области обучения.

Шаг 5: Xcode автоматически обработает изображение и начнет процесс обучения. По умолчанию на обучение модели уходит 10 итераций, в зависимости от характеристик вашего Mac и размера набора данных. Вы можете наблюдать за ходом обучения в окне терминала Playground.

Жду пока происходит обучение модели.

ШАГ 6: После завершения обучения вы можете проверить свою модель, перетащив папку Test в область тестирования. Xcode автоматически протестирует вашу модель и отобразит результат.

ШАГ 7: Сохраните вашу модель.

Интеграция в iOS приложение:

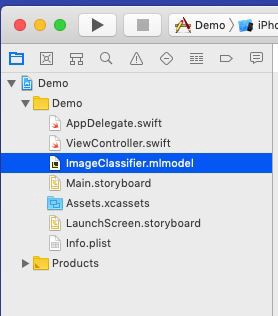

ШАГ 1: Откройте ваш X-code.

ШАГ 2: Создайте Single Page iOS приложение.

ШАГ 3: Откройте навигатор проекта.

ШАГ 4: Перетащите обученную модель в навигатор проекта.

Поместите вашу модель в навигатор проекта.

ШАГ 5: Откройте Main.storyboard и создайте простой интерфейс, как показано ниже, добавьте IBOutlets и IBActions для соответствующих представлений.

Добавьте UIImageView, UIButtons и UILabels.

ШАГ 6: Откройте файл ViewController.swift и добавьте следующий код в качестве расширения.

Описание: Здесь мы создаем расширение для нашего класса ViewController и реализуем UINavigationControllerDelegate и UIImagePickerControllerDelegate, чтобы отобразить UIImagePickerView когда пользователь нажимает PickImage UIButton. Убедитесь, что вы установили контекст делегата.

Шаги связанные с доступом к модели Core ML в iOS приложении

ШАГ 1: Убедитесь, что вы импортировали следующие библиотеки.

ШАГ 2: Создайте экземпляр нашего класса Core ML модели.

ШАГ 3: Чтобы заставить Core ML произвести классификацию, мы должны сначала сформировать запрос типа VNCoreMLRequest (VN обозначает Vision)

ШАГ 4: Убедитесь, что вы обрезали изображение так, чтобы оно было совместимо с моделью Core ML.

ШАГ 6: Теперь мы должны преобразовать наш UIImage в CIImage (CI:CoreImage), чтобы его можно было использовать в качестве входных данных для нашей Core ML модели. Это можно легко сделать, создав экземпляр CIImage, передав UIImage в конструкторе.

Описание: DispatchQueue — это объект, который управляет выполнением задач последовательно (или одновременно) в основном (или фоновом) потоке вашего приложения.

ШАГ 10: Поместите вышеуказанный код в пользовательскую функцию, как показано ниже.

Примечание: DispatchQueue.main.async используется для обновления объектов UIKit (в нашем случае это UILabel) с использованием UI Thread или Main Thread, поскольку все задачи классификации выполняются в фоновом потоке (background thread).

Листинг ViewController.Swift

Все готово!

Теперь запустите ваш Simulator и протестируйте приложение.

Примечание: Убедитесь что в библиотеке фотографий вашего Simulator у вас есть фото апельсинов и клубники.

Нажмите кнопку Pick Image

Выберите любое изображение

Нажмите кнопку Classify

Выберите другую картинку и нажмите Classify

Вы создали свое первое IOS приложение с использованием Core ML.

Что известно про чип M1 в новых Mac и MacBook: производительность, тесты, факты

В России начались официальные продажи новых MacBook Air, MacBook Pro и Mac mini на базе Apple M1.

Самое время разобраться с этими чипсетами, в основе которых лежит архитектура ARM: неужели они действительно настолько интересные, как про них говорит сама компания.

Вокруг Apple M1 предостаточно вопросов. Важно понять их производительность в разных задачах, как они ведут себя без активного охлаждения, что там с реальной автономностью и работой приложений, которые пока не успели адаптировать под ARM. Со всем этим и разберемся в данном материале.

Какие Mac получили чипсет Apple M1 в числе первых

В рамках WWDC 2020 Apple впервые сообщила про отказ от Intel и переход на чипсеты собственного производства, который должен состояться на протяжении двух лет. Компания также пообещала, что первые компьютеры на базе них должны появиться к концу года: 10 ноября, на очередной презентации, она их показала.

Пионерский чипсет получил название Apple M1. Сегодня он используется во всех новых MacBook Air, базовых двухпортовых MacBook Pro с диагональю 13 дюймов (топовые модели все еще комплектуются чипами Intel), а также в некоторых комплектациях Mac mini. Ожидать других вариантов в 2020 году не стоит.

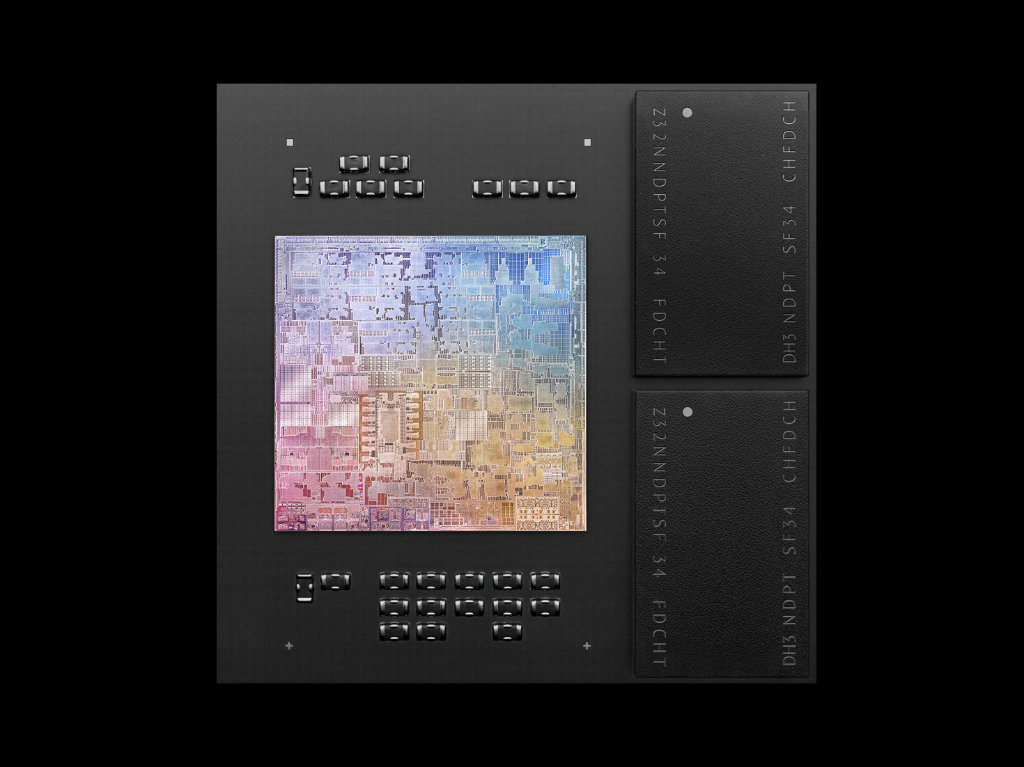

Apple M1 разработан с использованием 5-нанометрового технологического процесса и вмещает 16 миллиардов транзисторов. С одной стороны, у него есть явное родство с чипсетами из семейства Apple A: в их основе лежит архитектура ARM. С другой стороны, он заточен под потребности Mac и macOS 11 Big Sur.

Что кроме центрального процессора входит в Apple M1

Называть Apple M1 процессором нельзя — это система на чипе (SoC), состоящая из нескольких компонентов, которые максимально эффективно взаимодействуют между собой. Она отличается высоким уровнем интеграции, который значительно повышает производительность и энергоэффективность.

Центральный процессор. Он состоит из восьми ядер: первая четверка более производительная и отвечает за сложные задачи, вторая отличается повышенной энергоэффективностью и используется, когда высокая мощность не нужна. Они распределяют нагрузку между собой, в зависимости от задач.

Когда вы используете тяжелый софт (Final Cut для работы с видео или Logic Pro для музыкального продакшна), подключаются производительные ядра. Для работы с офисным контентом, текстовыми записями и прочим достаточно энергоэффективных ядер. Они же нужны, что еще обсудим дальше, для охлаждения.

Графический процессор. Он используется для работы с визуальным контентом самого разного рода. В Apple утверждают, что ничего мощнее на рынке интегрированных решений нет. Да, речь именно про варианты, которые встроены в чипсет: дискретная графика в данном случае в учет не берется.

В компании подчеркивают, что графического процессора, который встроен в чипсет Apple M1, хватит для плавного воспроизведения роликов в 8K, просмотра видео в разрешении 4K в несколько потоков, создания сложных сценариев в Unity и других задач, для которых нужна производительность графики.

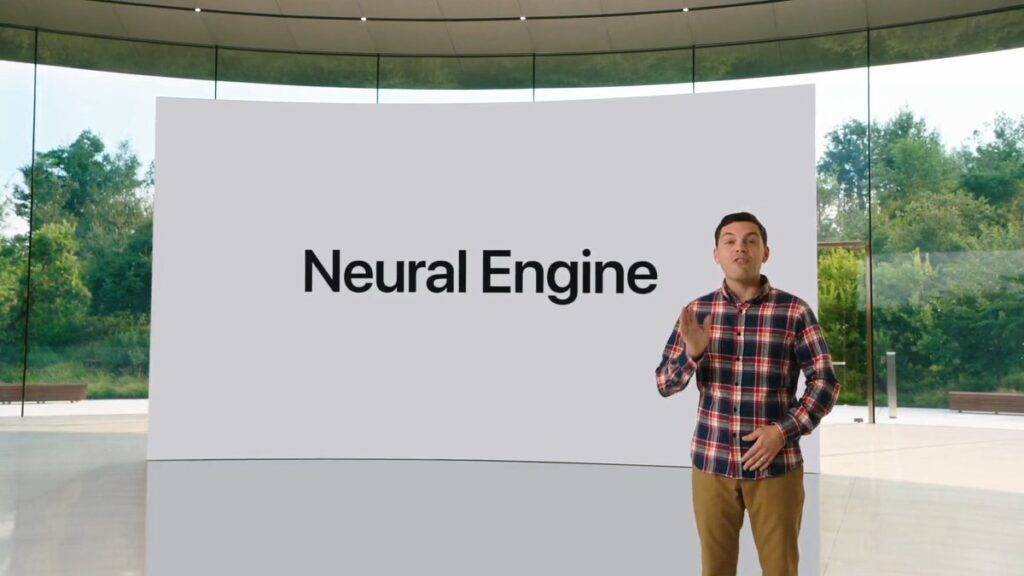

Система Neural Engine. Это фирменная система Apple, которая предназначена для работы с нейронными сетями. Она оборудована 16 выделенными ядрами, которые способны обрабатывать до 11 триллионов операций в секунду. В чипсетах из серии Apple A также используется Neural Engine, но менее производительный.

Работа Neural Engine видна во всех приложениях, в которых используется искусственный интеллект. Сама Apple приводит в пример приложение djay Pro Al, которое может разделять музыкальную композиции на отдельные дорожки (вокал, мелодия, бас, ударные) в режиме реального времени.

Оперативная память. Нельзя не отметить и то, что в Apple M1 компания впервые в истории Mac встраивает оперативную память прямо в чипсет. Это нужно для того, чтобы минимизировать задержки при взаимодействии ОЗУ, центрального и графического процесса, а также других систем.

В Apple M1 есть и другие комплектующие, которые предназначены для работы с памятью. Это, в том числе, касается твердотельных накопителей, скорость работы с которыми, благодаря новому чипсету, ощутимо вырастает. В компании говорят, что прирост может составлять до 100%.

Secure Enclave и AES‑модуль. Они предназначены для аппаратного обеспечения безопасности: для корректной работы Touch ID, оплаты через Apple Pay, хранения критически важных для системы данных. Ранее роль Apple M1 в подобном амплуа выполняли отдельные чипы T1 и T2.

Более того, именно на базе Apple M1 теперь работает блокировка активации Mac в удаленном формате, которая становится актуальной при потере или краже компьютера. Пока рано говорить про эффективность данной системы, но она должна ощутимо повыситься именно на новых гаджетах.

Чем чипсеты Apple M1 сегодня отличаются между собой

На первый взгляд, кажется, что в новых MacBook Air, MacBook Pro и Mac mini под управлением Apple M1 используется на 100% одинаковые чипсеты. Тем не менее, важно понимать, что это не так. В отличие от чипов серии Apple A, в данном случае присутствуют дифференциация по паре пунктов.

Информации по поводу реальной разницы в производительности данных решений пока нет. Тем не менее, MacBook Air и не предполагает регулярной интенсивной нагрузки, поэтому для рядовых и периодически сложных задач его все же хватит, а для постоянной работы с графикой лучше смотреть на MacBook Pro.

Оперативная память. Еще раз повторюсь, что сейчас она встроена непосредственно в сам чипсет. Ее может быть либо 8 ГБ, либо 16 ГБ. Второй вариант доступен только в кастомных MacBook Air, MacBook Pro и Mac mini: в российских реалиях за него придется доплатить 20 тыс. руб.

Какие важные вопросы про Apple M1 остаются без ответов

Несмотря на то, что в сети уже появились первые обзоры новых MacBook Air, MacBook Pro и Mac mini, они не отвечают на несколько интересных вопросов, которые могут быть важны для некоторых пользователей. Речь про странные ограничения компьютеров Apple на базе чипов M1.

Только два порта USB-C. В Mac под управлением Apple M1, которые сейчас доступны в продаже, большее количество пока не предусмотрено: в MacBook Air и MacBook Pro кроме 3,5-мм аудиовыхода вообще нет других интерфейсов для подключения, а в Mac mini доступны менее скоростные.

Не больше 16 ГБ ОЗУ и 2 TБ SSD. Базовые модели MacBook Air, MacBook Pro и Mac mini поставляются с SSD на 256 ГБ. Кастомные получится «разогнать» лишь до 2 ТБ: 4 ТБ пока добиться не получится. Это или ограничение контроллера памяти Apple M1, или вопрос позиционирования.

Это же касается и оперативной памяти, которая встроена в чипсет. Ее может быть или 8 ГБ, или 16 ГБ — более емкие варианты не предусмотрены. В Pro на 13 дюймов хотелось бы видеть и 32 ГБ, но, быть может, в более производительных моделях в будущем такой вариант также будет доступен.

Подключение одного монитора. К MacBook Air и MacBook Pro через USB-C получится подключить по одному монитору с разрешением до 6K: пару по 4K и меньше почему-то нельзя. Mac mini также поддерживает подключение еще одного дисплея через HDMI, но у портов USB-С такое же ограничение.

Какое охлаждение нужно для M1: активное или пассивное

Компьютеры Apple на базе чипов M1 предполагают два вида охлаждения: активное с использованием вентиляторов и пассивное без подвижных элементов. Первое касается MacBook Pro и Mac mini, второе — MacBook Air. К чему такое разделение, если в последнем может быть настолько же мощный чип, как в первых?

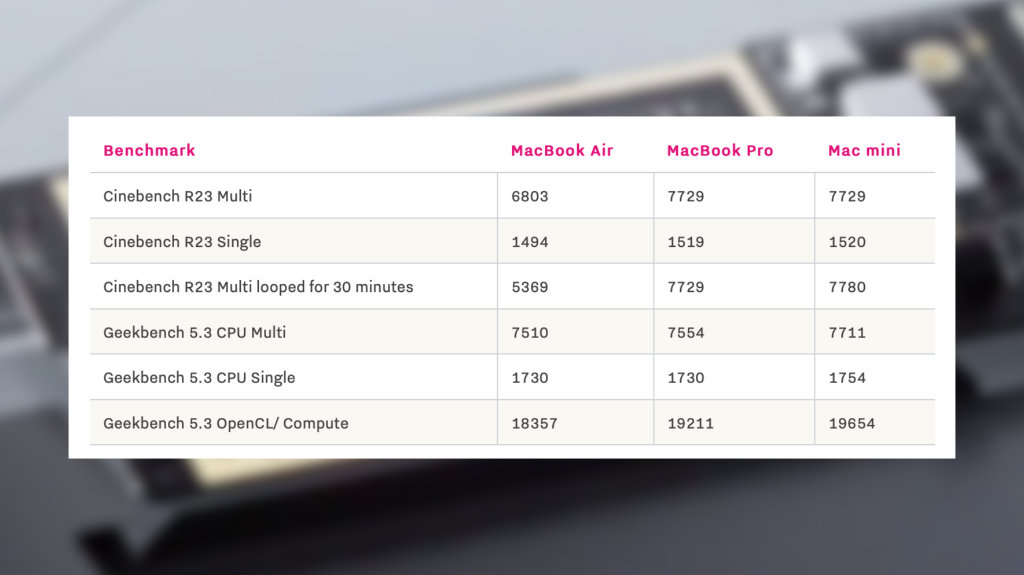

Первые обзоры новых компьютеров Apple показали, что чипы M1 с одинаковой конфигурацией работают одинаково хорошо на любом компьютере. Вопрос охлаждения встает только при длительной интенсивной нагрузке: когда чип подвергается долгим синтетическим тестам или занимается рендером графики.

У M1 специфическая система троттлинга. В отличие от решений Intel, ядра, которые входят в его комплект, всегда работают на максимальной для себя частоте. Чтобы понизить свою температуру, чипсет переводит нагрузку с производительных ядер на эффективные : так скорость работы падает вместе с градусами.

В MacBook Air нет активного охлаждения, поэтому с подобным процессом при большой долговременной нагрузке получится сталкиваться чаще, чем на MacBook Pro и на Mac mini. Поэтому первый больше подходит для обычного использования, а пара последних заточена и под напряженное.

Какое время автономной работы у первых ноутбуков на M1

MacBook Air комплектуется аккумулятором на 49,9 Вт∙ч, MacBook Pro — на 58,2 Вт∙ч. По заверениям Apple, первый вместе с M1 должен проработать до 15 часов при интернет-серфинге и до 18 часов при воспроизведении фильмов из сервиса Apple TV. Второй: 17 и 20 часов соответсвенно.

По первым обзорам ноутбуков, на которые есть ссылке в начале тексте, реальное время автономной работы находится на уровне от 8 до 10 часов. Да, оно меньше, но вполне соответсвует 50% увеличению в случае MacBook Air и до 100% в ситуации с MacBook Pro, о чем шла речь на презентации Apple.

Результат на уровне 8–10 часов кажется действительно удивительным. Он начинает становится еще более фантастическим, если учитывать возможность зарядки с помощью мощных внешних аккумуляторов с поддержкой Power Delivery. «Банки» средней руки легко добавят к автономности 100% и даже 150%.

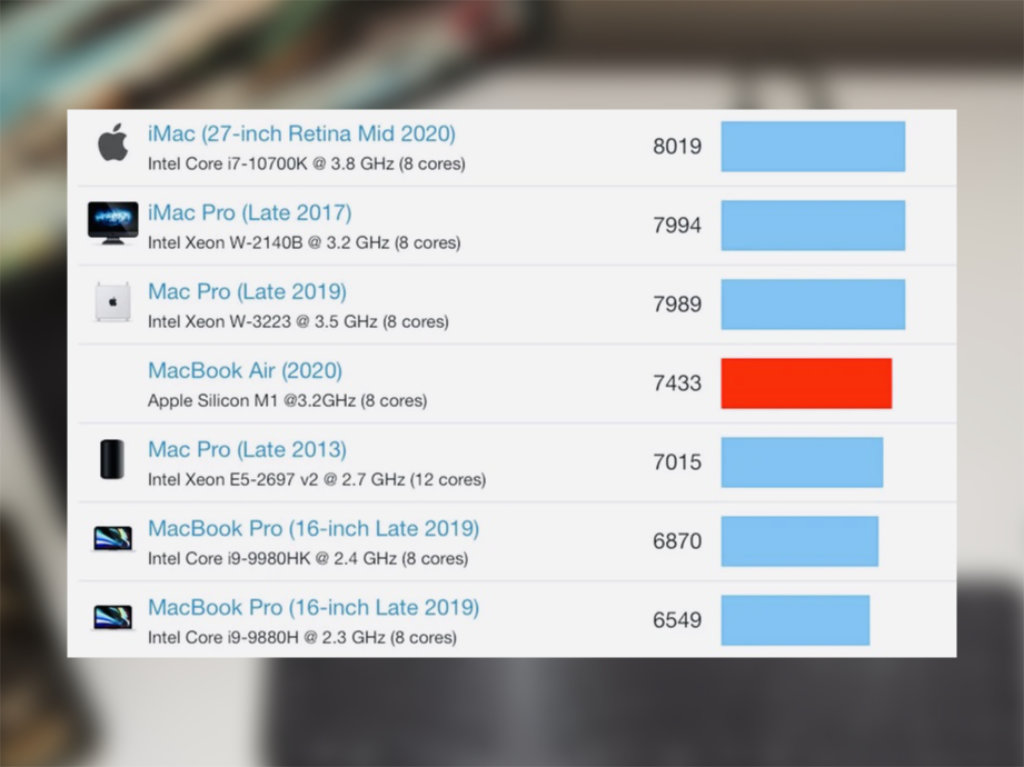

Что с реальной производительностью чипсета Apple M1

В Geekbench центральный процессор MacBook Air на базе M1 набирает почти 1700 баллов в одноядерном тесте и обгоняет абсолютно все компьютеры, которые компания Apple когда-либо выпускала. В многоядерном тесте он набирает более 7400 баллов и вплотную приближается к Mac Pro 2019 года на базе Intel Xeon.

В синтетическом тесте GFXBench графический процессор Apple M1 обогнал видеокарты Nvidia GeForce GTX 1050 Ti и AMD Radeon RX 560. В компании не обманывали по поводу того, что это — самая производительная интегрированная графика. На средних настройках получится и пару каток в Dota 2 сообразить.

По графическому тесту Cinebench, результаты которого также представлены выше, становится понятно, что при серьезной длительной нагрузке MacBook Air начинает отставать от MacBook Pro и Mac mini. Как уже отмечалось выше по тексту, это связано с использованием пассивного охлаждения.

Как на базе чипа Apple M1 работают разные приложения

Для начала нужно отметить, что на компьютерах под управлением Apple M1 нужно говорить сразу про три типа приложений. Во-первых, есть программы, которые адаптированы под новую архитектуру. Во-вторых, важно отметить эмуляцию приложений неподдерживаемых через Rosetta 2. В-третьих, софт для iOS и iPadOS.

Конечно, лучше всего Apple M1 работает с приложениями, которые под него адаптированы. В числе первых поддержку данного чипсета получил графический редактор Affinity Photo, который сам я достаточно давно использую в качестве альтернативы для Adobe Photoshop. Apple показала его на презентации.

Даже с учетом падения производительности на уровне 25–30% из-за Rosetta 2 приложения также работают без нареканий. Это, в том числе, касается того же Adobe Photoshop, который обещают адаптировать только в первом квартале 2021 года. Он должен показывать большую скорость, чем на предшественниках.

Подводя итоги: краткое резюме про чипсет Apple M1

Во-первых, учитывайте дифференциацию Apple M1, которая сильно отличает их от линейки Apple A. В Mac на базе фирменных чипсетов может использоваться разный объем оперативной памяти, а также разное количество графических ядер. Внимания заслуживает и тип охлаждения: активное, безусловно, лучше.

Во-вторых, важно трезво оценивать актуальные ограничения Apple M1. На данный момент времени чипсеты не поддерживают больше 16 ГБ оперативной памяти и больше 2 ТБ постоянной. Они не работают с парой мониторов через USB-C, да и этих портов в них пока не бывает больше двух штук.

В-третьих, время реальной автономной работы ноутбуков не может не радовать: 8–10 часов при полноценном использовании. Оно должно еще увеличиться, когда большинство приложений будут использовать Apple M1 нативно, а не через эмуляцию средствами Rosetta 2.

В-четвертых, Mac на базе Apple M1 можно брать уже сегодня. Они отлично работают даже с не адаптированными приложениями, и падение производительности с ними на уровне 25–30% можно пережить. Если говорить про адаптированные, чип показывает мощность на уровне Mac Pro 2019 года. Поразительно.

В-пятых, рассчитывать на полноценную поддержку мобильных приложений не стоит. У разработчиков есть возможность ограничить их установку на Mac. Заточенные под сенсорное управление программы все равно не будут работать на 100% корректно без его использования.